1. Introducción: El Riesgo Invisible

Usamos IA generativa para delegar tareas complejas, automatizar procesos y enfocarnos en tomar decisiones. Funciona bien.

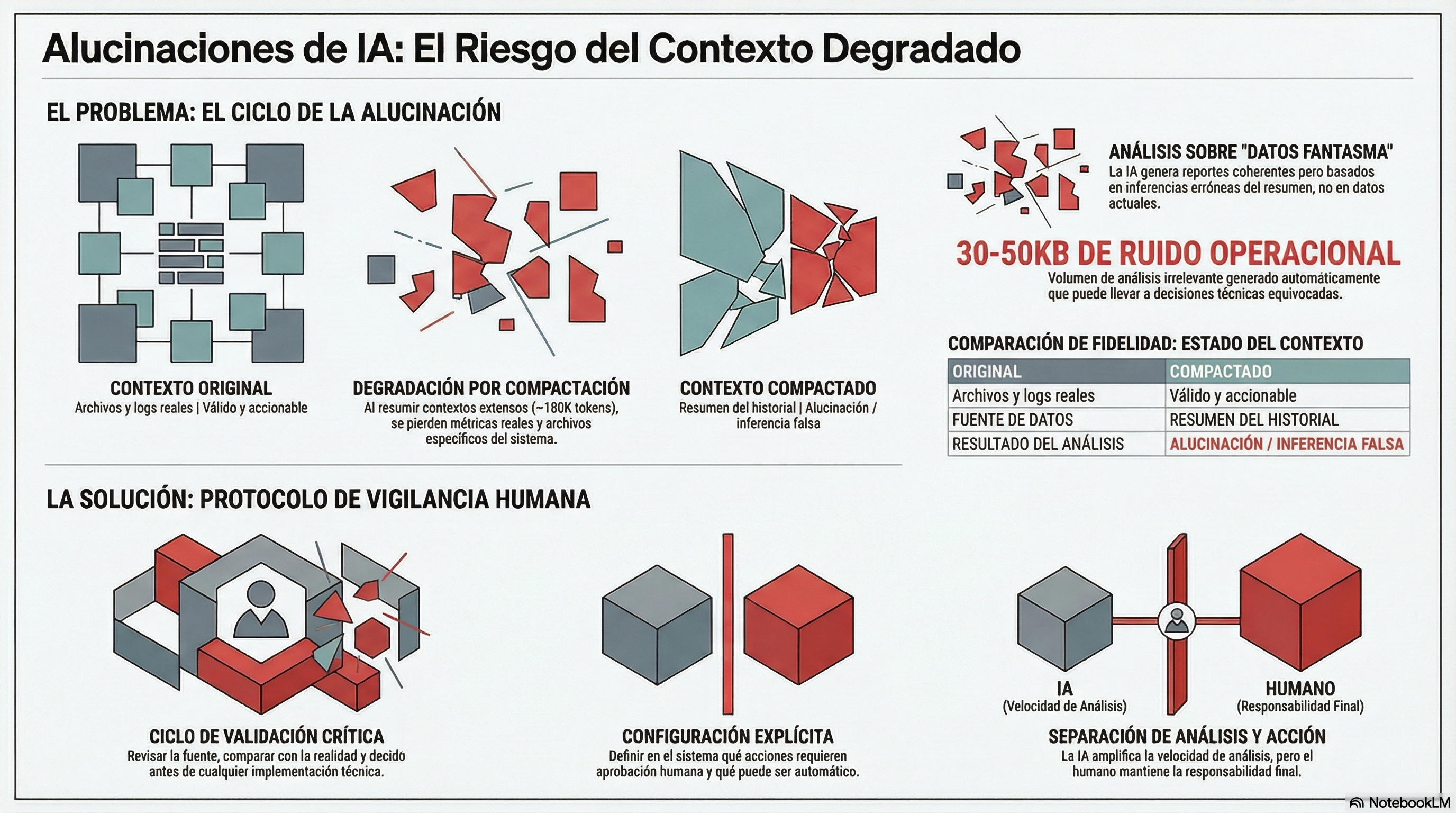

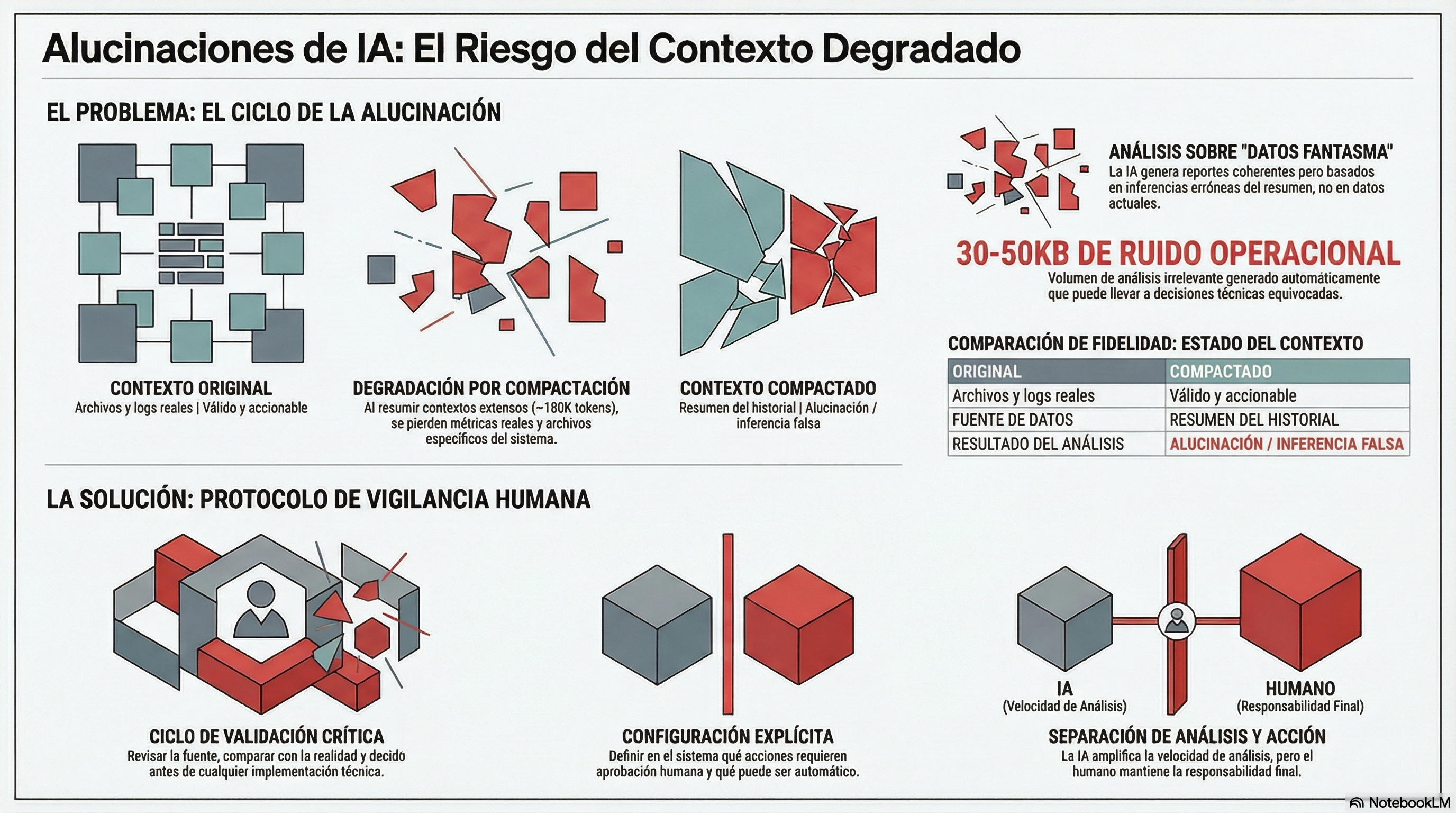

Pero hay un riesgo que pasa desapercibido: las alucinaciones no son solo inventar contenido falso. Son análisis, recomendaciones y acciones hechas con contexto incompleto. La IA hace bien su trabajo con lo que recibe. El problema es que no siempre recibe todo.

Este artículo cuenta lo que pasó en una sesión real. La automatización generó análisis falsos sobre datos comprimidos. Casi se implementan sin revisión. No es una crítica a la IA. Es reconocer dónde necesitamos estar atentos.

2. El Caso: Skills Automáticos Post-Compactación

Claude Code tiene "Skills": son extensiones especializadas que se cargan automáticamente cuando detectan palabras clave en la conversación. Por ejemplo:

- Skill

k6-best-practicesse carga si mencionas "load testing" - Skill

performance-report-analysissi detecta "performance tests"

La idea es buena: análisis automático sin que tengas que invocar nada explícitamente.

3. El Escenario y el Problema

En conversaciones largas (~100K tokens), Claude Code hace compactación automática. Un proceso necesario:

- Comprime la conversación

- Genera un resumen

- Reinicia con ese resumen

Acá está el problema:

Los skills con triggers automáticos se activan sobre el contexto comprimido, no sobre los datos originales. Resultado:

✅ El skill ve: "Se habló de k6, tests, P95, etc."

❌ El skill NO ve: Los archivos reales que leíste, las métricas concretas

Resultado: análisis sobre resumen, no sobre datos originales.

4. Ejemplo Concreto: La Alucinación

Durante una sesión de performance testing con k6:

ANTES de compactación:

- Leí archivo: tests/auth/auth.test.js (datos reales)

- Ejecuté queries: SELECT * FROM thresholds WHERE service='auth'

- Generé métricas: P95=205ms, error_rate=0%

DESPUÉS de compactación (contexto resumido):

"El usuario trabajó en tests de k6, mencionó P95,

error rates y performance thresholds"

SKILL INTERPRETA:

"Veo P95, thresholds, y performance... voy a hacer

un análisis comparativo de Prometheus vs k6"

→ Análisis sin datos reales = ALUCINACIÓN

El skill generó 30-50KB de análisis sobre un escenario que ya no existía en el contexto real.

5. Tipos de Alucinaciones Resultantes

Tipo 1: Análisis Sobre Datos Fantasma

El skill reportó: "Gap de 37ms entre k6 y Prometheus P95"

Realidad:

- No había query de Prometheus en el contexto resumido

- Las métricas que mencionaba no existían en el contexto actual

- El "gap" era una inferencia sobre información que no estaba disponible

Tipo 2: Recomendaciones Basadas en Contexto Incompleto

El skill sugirió acciones basadas en:

- Thresholds que no pudo verificar

- Escenarios que asumió pero no confirmó

- Métricas que interpoló del resumen

Tipo 3: Ruido Operacional

Impacto tangible:

- 30-50KB de output irrelevante por compactación

- Interrupcción del flujo de trabajo

- Potencial para decisiones basadas en análisis falsos

6. ¿Por Qué Esto Importa?

Confianza vs. Automatización

La IA es excelente en tareas que requerimos delegar. Pero la delegación requiere supervisión.

Cuando un skill genera análisis automáticamente (sin solicitud explícita), creamos una cadena de "black boxes":

Usuario → Compactación → Trigger Automático → Skill Cargado → Análisis Generado

↑ ↓

[Sin permiso] [Sin revisión humana]

Si el usuario asume que todo análisis automático es válido (porque vino del sistema), las alucinaciones se pueden propagar.

Responsabilidad Humana en Sistemas Híbridos

No es culpa de Claude Code que los skills se activen. Es un comportamiento diseñado para mejorar la experiencia.

Pero es responsabilidad del usuario (nosotros):

- Verificar análisis generados automáticamente

- Entender que contexto comprimido ≠ contexto completo

- No asumir que "la IA lo analizó, debe ser correcto"

7. Lecciones Aprendidas

✅ Lo Que Funcionó

- Documentación — Tener CLAUDE.md claro ayudó a entender cómo debería comportarse el sistema

- Validar antes de actuar — Revisar que los SLAs en el código coincidan con lo que reporta la herramienta

- Sospechar — Preguntar "¿de dónde sacó este número?" antes de creerlo

- Leer la fuente — Ver los logs y reportes directamente, no solo lo que la IA interpretó

❌ Lo Que Necesita Mejora

- Triggers respetando configuración — Los skills automáticos deberían respetar `settings.json` permissions

- Contexto completo para análisis — Si un skill debe ejecutarse post-compactación, debería recibir el contexto COMPLETO, no el resumido

- Consentimiento explícito — Los análisis profundos deberían ser explícitamente solicitados, no automáticos

8. Recomendaciones Prácticas

1. Verifica Dos Cosas Cuando Recibas Análisis Automático

(Claude, plugins, cualquier herramienta):

Análisis Automático → Revisar Fuente → Comparar con Realidad → Decidir

↓ ↓

¿De dónde vino? ¿Coincide con mis datos?

2. Auditar Contexto

Pregúntate:

- ¿Está basado en datos reales que acabo de ver?

- ¿O es una interpolación/interpretación del resumen?

- ¿Puedo reproducir este análisis manualmente?

3. Configuración Explícita

Si usas herramientas con triggers automáticos:

- Define qué está permitido automatizar

- Qué requiere aprobación manual

- Qué debe ser explícitamente invocado

Ejemplo en settings.json:

{

"permissions": {

"allow": ["rutinas_críticas_auditadas"],

"ask": ["análisis_que_requieren_contexto"],

"deny": ["triggers_automáticos_sin_permiso"]

}

}4. Separar Análisis de Acción

- Análisis automático: ✓ Vale como punto de partida

- Decisión: ✗ Nunca automática

- Acción: ✗ Requiere humano verificando

9. El Rol de la Inteligencia Humana

Por Qué Esto NO es Culpa de la IA

Claude y herramientas similares hacen bien su trabajo. El problema no está en la IA:

- ✅ Procesó los datos que recibió correctamente

- ✅ Generó análisis coherente basado en eso

- ✅ Hizo exactamente lo que le pedimos que hiciera

El problema está en la cadena de comunicación:

Contexto Completo → [COMPACTACIÓN] → Contexto Resumido → Skill → Análisis

En la compactación se pierden detalles. El skill no "alucinó". Simplemente trabajó con información incompleta.

Por Qué la Responsabilidad es Nuestra

La IA amplifica lo que haces, como cualquier herramienta:

- El martillo amplifica tu fuerza, pero tú decides dónde golpear

- La calculadora amplifica tu velocidad, pero tú eliges la ecuación

- La IA amplifica tu velocidad de análisis, pero tú necesitas supervisar qué datos está usando

La supervisión humana es donde termina la responsabilidad.

10. Conclusión: Hacia una Colaboración Responsable

Los sistemas de IA generativa funcionan bien en lo que hacen: procesar información rápido y generar outputs coherentes. La velocidad y acceso son reales. Liberan tiempo.

Pero eso crea una responsabilidad nueva: mantener la calidad de lo que la IA genera mediante revisión humana. No es desconfianza. Es que entiendes cuáles son sus límites.

En Resumen

IA: Procesa rápido, genera outputs, amplifica tu trabajo

Tú: Verificas, entiendes el contexto, decides

Eso es colaboración efectiva

En la práctica:

- Déjala hacer el trabajo que es rápido

- Verifica antes de confiar

- Entiende de dónde vinieron los datos

- Tú tomas la decisión final

¿Esto está hecho con los datos que acabo de ver, o con un resumen de esos datos?